En una era dominada por la tecnología, donde la inteligencia artificial forma parte de nuestro día a día, surge una pregunta: ¿Cómo pueden las máquinas aprender, adaptarse y «pensar» de manera similar a nosotros? La respuesta nos lleva a un concepto que fusiona neurociencia, psicología y computación: el conexionismo.

Esta teoría, inspirada en la intricada red neuronal de nuestro cerebro, no solo nos brinda pistas sobre cómo funciona nuestra mente, sino que también está en el corazón de algunas de las tecnologías más avanzadas de hoy día (como ChatGPT).

Hace poco realicé un directo en el canal de YouTube de Panama Hitek. En él, mostré cómo un sistema de elementos interconectados puede «aprender» a realizar operaciones matemáticas básicas. Este sistema no solo comprende los datos con los que fue entrenado, sino que también puede abordar operaciones más avanzadas que las presentadas durante el entrenamiento. Puedes ver el video aquí:

Dando seguimiento a lo mostrado en el video, en este post, hablaré sobre cómo simples conexiones, tanto en nuestro cerebro como en las máquinas, pueden llevar a decisiones y acciones complejas. Al mirar el conexionismo, veremos cómo pequeñas piezas trabajando juntas pueden hacer cosas sorprendentes.

Historia del Conexionismo

El conexionismo, a pesar de estar en el centro de atención en las últimas décadas debido a los avances tecnológicos, no es una idea nueva. Sus raíces se remontan a varios siglos atrás, pero es en el siglo XX cuando realmente comienza a tomar forma.

En los primeros días de la psicología como ciencia, existían teorías que sugerían que la mente funcionaba a través de redes de conexiones. Estas ideas iniciales se basaban en observaciones del sistema nervioso y la manera en que las neuronas parecían estar interconectadas.

En 1949, el neuropsicólogo Donald Hebb propuso una regla de aprendizaje que se ha convertido en fundamental para el conexionismo. La «Regla de Hebb» sugiere que si dos neuronas se activan al mismo tiempo, la conexión entre ellas se fortalece. Esta idea sentó las bases para entender cómo las redes neuronales podrían aprender y adaptarse con el tiempo.

En los años 50 y 60, surgieron los primeros modelos de redes neuronales artificiales. Sin embargo, enfrentaron críticas y limitaciones, y durante un tiempo, la atención se desplazó hacia otros modelos de inteligencia artificial. No obstante, en la década de 1980, hubo un resurgimiento del interés en las redes neuronales, impulsado por avances en la computación y nuevos algoritmos, como el de retropropagación (backpropagation).

Con la llegada de la computación de alto rendimiento y grandes conjuntos de datos en el siglo XXI (alrededor del año 2010), el conexionismo y las redes neuronales artificiales experimentaron un renacimiento. Estas herramientas permitieron entrenar redes mucho más grandes, llevando al desarrollo de deep learning y a revoluciones en campos como el reconocimiento de imágenes y el procesamiento del lenguaje natural.

A lo largo de los años, varias figuras han sido fundamentales para el desarrollo del conexionismo. Aparte de Donald Hebb, personas como Frank Rosenblatt, con su «Perceptrón», y Geoffrey Hinton, uno de los pioneros del deep learning, han sido esenciales para avanzar en la comprensión y aplicación de estas ideas.

Conceptos Básicos del Conexionismo

Las redes neuronales, ya sean biológicas o artificiales, se componen de unidades individuales, a menudo comparadas con neuronas. Estas unidades se conectan entre sí a través de conexiones que transmiten información. Cada conexión tiene un «peso», que determina la fuerza y la dirección del enlace. Estos pesos pueden ser positivos (estimulantes) o negativos (inhibitorios), y su valor influirá en cómo se propaga la información a través de la red.

En el ámbito de las redes neuronales artificiales, estas unidades y conexiones se modelan matemáticamente, y los pesos se ajustan durante el proceso de aprendizaje.

El aprendizaje en las redes neuronales se refiere al proceso mediante el cual los pesos de las conexiones se ajustan en respuesta a la experiencia. Por ejemplo, si la red produce un error en su salida (como una predicción incorrecta), los pesos se ajustarán para reducir ese error en el futuro. Una técnica comúnmente utilizada en redes neuronales artificiales es la «retropropagación», que calcula el error en la salida y lo propaga hacia atrás a través de la red, ajustando los pesos para mejorar el rendimiento.

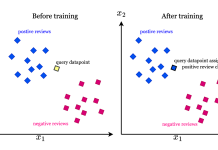

A diferencia de los sistemas tradicionales donde cada pieza de información podría estar almacenada en un lugar específico, el conexionismo sostiene que la información está distribuida en toda la red. Esto significa que un concepto, recuerdo o pieza de información no está representado por una única unidad o «neurona», sino por el patrón de actividad en muchas unidades. Esto tiene varias ventajas, como la capacidad de la red para ser más resistente a daños (si una unidad falla, la información no se pierde por completo) y la habilidad de generalizar a partir de ejemplos previamente vistos a situaciones nuevas.

Las redes neuronales no «memorizan» en el sentido tradicional del término; en cambio, se especializan en generalizar. En lugar de almacenar información específica en lugares determinados, adaptan sus conexiones en respuesta a patrones y regularidades en los datos con los que se entrenan. Este proceso de ajuste permite que, al enfrentarse a información nueva o variante, no busquen una «memoria» exacta.

En su lugar, las redes neuronales utilizan su estructura adaptada para hacer inferencias basadas en lo que han «aprendido» previamente. Es esta capacidad de generalización la que las hace tan efectivas en tareas como el reconocimiento de imágenes o el procesamiento de lenguaje, donde los datos pueden tener pequeñas variaciones pero aún representan un concepto o categoría similar.

Estos conceptos fundamentales del conexionismo proporcionan la base para entender cómo las redes neuronales, tanto naturales como artificiales, procesan y almacenan información.

Comparación entre el Cerebro y las Máquinas

El cerebro humano es una maravilla de la naturaleza, compuesto por aproximadamente 86 mil millones de neuronas interconectadas en una red increíblemente compleja. Las máquinas, en su intento de imitar esta maravilla, han dado lugar a lo que conocemos como redes neuronales artificiales. Aunque ambos sistemas, el biológico y el artificial, se basan en la idea de unidades interconectadas, existen similitudes y diferencias fundamentales entre ellos.

Similitudes

- Unidades y Conexiones: Tanto en el cerebro como en las redes neuronales artificiales, la información se procesa a través de unidades (o neuronas) que están interconectadas. Estas conexiones transmiten información y pueden fortalecerse o debilitarse con el tiempo.

- Aprendizaje Adaptativo: Ambos sistemas tienen la capacidad de aprender y adaptarse con el tiempo. En el cerebro, este aprendizaje puede ser el resultado de experiencias y recuerdos, mientras que en las redes neuronales artificiales, se basa en ajustar los pesos de las conexiones mediante algoritmos específicos.

- Procesamiento Paralelo: Tanto el cerebro humano como las redes neuronales artificiales procesan información en paralelo, lo que les permite manejar múltiples entradas y salidas simultáneamente.

Diferencias

- Complejidad y Escala: Aunque las redes neuronales artificiales pueden ser vastas y complejas, todavía palidecen en comparación con la complejidad del cerebro humano. Mientras que una red neuronal artificial puede tener millones de «neuronas», el cerebro humano tiene miles de millones.

- Plasticidad: El cerebro no solo ajusta las conexiones entre las neuronas, sino que también puede generar nuevas neuronas y formar nuevas conexiones a lo largo de la vida, un proceso conocido como neurogénesis y plasticidad sináptica. Las redes neuronales artificiales, por otro lado, generalmente tienen una estructura fija una vez diseñadas.

- Eficiencia Energética: A pesar de su inmensa capacidad de procesamiento, el cerebro humano es increíblemente eficiente en términos de energía, utilizando aproximadamente 20 vatios de potencia. Las redes neuronales artificiales, especialmente las más grandes, pueden requerir cantidades significativas de energía y recursos computacionales para operar.

- Mecanismo de Aprendizaje: Aunque ambas redes aprenden, el método exacto y los detalles del aprendizaje son diferentes. El cerebro humano utiliza una variedad de mecanismos biológicos y químicos para el aprendizaje, mientras que las redes neuronales artificiales dependen de algoritmos matemáticos.

Estas similitudes y diferencias subrayan cómo, aunque estamos inspirados por la naturaleza para diseñar máquinas inteligentes, todavía hay mucho que no entendemos completamente sobre la complejidad y la maravilla del cerebro humano.

Aplicaciones Prácticas del Conexionismo

El conexionismo, a través de su influencia en el desarrollo de redes neuronales artificiales, ha dejado una marca indeleble en la tecnología moderna. Estas redes, que emulan la estructura y función básica de las redes neuronales en el cerebro, se han convertido en la columna vertebral de numerosas aplicaciones que utilizamos en nuestra vida diaria.

Ejemplos concretos

- Reconocimiento de Imágenes: Aplicaciones como la identificación facial en redes sociales o la detección automática de objetos en imágenes se basan en redes neuronales profundas. Estas redes pueden identificar y etiquetar objetos y personas con una precisión asombrosa, a menudo superando a los humanos en tareas específicas.

- Procesamiento de Lenguaje Natural (PLN): Desde asistentes virtuales como Siri o Alexa hasta traductores automáticos como Google Translate, las redes neuronales han revolucionado la forma en que las máquinas comprenden y generan lenguaje.

- Juegos: Las redes neuronales han sido utilizadas para entrenar agentes inteligentes capaces de jugar y, a menudo, superar a los campeones humanos en juegos complejos como Go, ajedrez, juegos de Atari, entre otros.

- Recomendaciones Personalizadas: Cuando te encuentras navegando en plataformas como Netflix o Spotify y recibes sugerencias basadas en tus preferencias anteriores, hay una buena posibilidad de que estés viendo el trabajo de sistemas basados en redes neuronales.

Caso de estudio: ChatGPT

ChatGPT es un excelente ejemplo de cómo el conexionismo y las redes neuronales profundas han influido en la tecnología moderna. Basado en el modelo GPT (Generative Pre-trained Transformer) de OpenAI, ChatGPT es capaz de generar respuestas coherentes y contextuales en conversaciones en tiempo real. Lo que lo hace impresionante es su capacidad para entender y generar lenguaje de manera muy similar a un humano, a pesar de que, en realidad, no «comprende» el lenguaje de la misma manera que lo hacemos nosotros.

El modelo detrás de ChatGPT se entrena en vastas cantidades de texto, permitiéndole generar respuestas basadas en patrones y estructuras lingüísticas que ha «visto» durante su entrenamiento. Aunque no tiene conciencia o verdadera comprensión, su habilidad para emular conversaciones humanas es un testimonio del poder del conexionismo y las redes neuronales en la tecnología actual.

Estas aplicaciones prácticas demuestran la versatilidad y el poder del conexionismo en nuestra vida diaria y cómo ha transformado la interacción entre humanos y máquinas. El conexionismo ha tenido un impacto profundo en la comprensión de la mente y el desarrollo de la inteligencia artificial, ofreciendo tanto potencial como áreas de controversia.

Beneficios del Conexionismo

- Flexibilidad y Adaptabilidad: A diferencia de los sistemas tradicionales basados en reglas, las redes neuronales pueden adaptarse y aprender de los datos. Esto significa que pueden mejorar su rendimiento con el tiempo y adaptarse a nuevos datos o situaciones.

- Generalización: Como hemos mencionado anteriormente, una de las fortalezas clave de las redes neuronales es su capacidad para generalizar a partir de ejemplos previos. Esto les permite manejar situaciones o datos que nunca han visto antes, basándose en lo que han aprendido.

- Procesamiento Paralelo: Las redes neuronales procesan información en paralelo, lo que las hace particularmente eficientes para tareas que involucran grandes cantidades de datos.

- Tolerancia a Fallos: Debido a su representación distribuida, las redes neuronales pueden ser resistentes a ciertos tipos de daños o fallos. Si algunas unidades fallan, la red a menudo puede seguir funcionando sin mucha degradación en su rendimiento.

Limitaciones y Críticas del Conexionismo

- Interpretabilidad: Una crítica común a las redes neuronales, especialmente a las profundas, es que son «cajas negras». Esto significa que, aunque pueden realizar tareas con alta precisión, es difícil entender exactamente cómo llegan a sus decisiones.

- Sobreajuste: Si no se entrenan adecuadamente, las redes neuronales pueden «memorizar» los datos de entrenamiento en lugar de generalizar a partir de ellos, lo que lleva a un fenómeno llamado sobreajuste. Esto puede hacer que la red funcione mal en datos nuevos o desconocidos.

- Necesidad de Grandes Cantidades de Datos: Las redes neuronales, en particular las más complejas, a menudo requieren grandes cantidades de datos para entrenarse eficazmente. Esto puede ser un desafío en situaciones donde los datos son escasos.

- No es una Replica Exacta del Cerebro: Aunque las redes neuronales artificiales están inspiradas en el cerebro humano, están lejos de replicar su verdadera complejidad y funcionamiento. Algunos críticos argumentan que el conexionismo, mientras ofrece insights, no captura completamente la esencia de la cognición humana.

- Costo Computacional: Las redes neuronales profundas, en particular, pueden ser costosas en términos de recursos computacionales, tanto en términos de memoria como de capacidad de procesamiento.

En resumen, mientras que el conexionismo y las redes neuronales ofrecen poderosas herramientas y perspectivas para entender la mente y construir sistemas inteligentes, también vienen con su propio conjunto de desafíos y críticas que deben ser considerados.

Conclusión

A lo largo de este post, hemos navegado por el fascinante mundo del conexionismo, una teoría que busca entender cómo simples conexiones pueden dar lugar a patrones de pensamiento y comportamientos complejos. Desde sus raíces históricas, donde se destacaron figuras como Donald Hebb, hasta su influencia en el diseño y funcionamiento de las modernas redes neuronales artificiales, el conexionismo ha sido un pilar en nuestra comprensión de la cognición y la inteligencia artificial.

Hemos observado cómo, a pesar de sus diferencias, el cerebro humano y las redes neuronales artificiales comparten similitudes sorprendentes en su estructura y funcionamiento, y cómo ambos sistemas se benefician de su capacidad para adaptarse y aprender de la experiencia. También hemos explorado algunas de las aplicaciones prácticas más impactantes del conexionismo en la tecnología moderna, desde el reconocimiento de imágenes hasta las conversaciones realistas con modelos como ChatGPT.

Sin embargo, como cualquier teoría o herramienta, el conexionismo no está exento de críticas y limitaciones. Si bien ofrece una perspectiva poderosa, todavía estamos lejos de replicar completamente la complejidad y la maravilla del cerebro humano.

Mirando hacia el futuro, es evidente que el conexionismo seguirá desempeñando un papel fundamental en la era tecnológica. A medida que continuamos avanzando en nuestra comprensión del cerebro y mejorando nuestras máquinas, es probable que veamos aún más aplicaciones y avances impulsados por esta teoría. El conexionismo, con su énfasis en la interconexión y el aprendizaje, nos recuerda que, ya sea en seres humanos o en máquinas, es a través de la colaboración y la adaptación que logramos los mayores logros.

Espero que la información aquí presentada sea útil para ustedes. Los invito a revisar el portal de Machine Learning en el que aplicamos todos los conceptos desarrollados en este blog en la resolución de problemas del mundo real.